AI記事のファクトチェック体制|人間とAIの協業フロー構築術

AI記事のファクトチェックはなぜ「人間との協業」が必須なのか

AIライティングツールの進化は、コンテンツ制作の現場に革命をもたらしました。しかし、その裏側で多くのメディア運営者が直面しているのが、AIが生成する情報の信頼性という根源的な課題です。AI単体でのファクトチェックには限界があり、人間の専門的な知見との協業が不可欠である理由を、まず深く掘り下げていきましょう。このテーマの全体像については、AIライティングのハルシネーション対策運用ルールで体系的に解説しています。

AIは嘘をつく:ハルシネーションの現状と読者の不信感

AIは嘘をつきます。2026年現在において、ユーザー(読者)は無意識のうちにAIが生成した記事であることを感じ取り、「嘘が含まれているのではないか」という先入観を持ってコンテンツに接する傾向が強まっています。

実際に、AIが生成した記事には、事実無根の情報をそれらしく記述してしまう「ハルシネーション」が依然として発生します。これはAIが意図的に嘘をついているわけではありません。AIは、学習した膨大なデータから「次に来る確率が最も高い単語」を予測して文章を生成しているに過ぎず、その内容の真偽を自己検証する能力は本質的に持っていないのです。この技術的背景を理解することが、ファクトチェック体制を構築する第一歩となります。

だからこそ、AIが生成した記事をそのまま公開することは、読者の信頼を損ない、メディアのブランド価値を毀損する重大なリスクを伴います。公開前には、必ず人間の目によるチェックと修正が不可欠です。

効率的なチェック手法の一つとして、AIに事実確認をさせる際に、正しい、あるいは正しくないと判断した根拠となる「出典URL」を明示させ、その情報源自体の信頼性も含めて人間が検証するプロセスが有効です。

AIチェックの精度と限界:何をどこまで任せられるのか

AIによるファクトチェックは、決して万能ではありません。その能力の範囲と限界を正確に把握し、過信しないことが重要です。

AIが得意なこと(優秀なアシスタントとしての役割):

- 誤字脱字、表記ゆれの検出

- 単純な事実関係の照合(例:「日本の首都は東京ですか?」)

- 数値や固有名詞の正誤チェック

- コピーコンテンツの検知

AIが苦手なこと(人間の判断が必要な領域):

- 情報の鮮度・リアルタイム性の判断

- 情報源の権威性・信頼性の評価

- 倫理的・社会的な配慮が必要な判断

- 未だWeb上に存在しない、書き手の一次情報や独自の経験に基づく内容の検証

研究や評価条件によって差はありますが、AIによるファクトチェックは8割台〜9割程度の精度が報告されることもある一方で、対象領域や与える根拠(証拠)の質によっては誤判定も起こり得ます。裏を返せば、残りの5%〜20%には誤りが含まれる可能性があるということです。特に専門性の高い領域やYMYL(Your Money or Your Life)分野においては、このわずかな誤りが読者の人生や財産に深刻な影響を及ぼしかねません。

結論として、AIはあくまで「網羅的な一次スクリーニングを行う優秀なアシスタント」と位置づけるべきです。最終的な品質と正確性を保証する責任は、人間が担う必要があります。

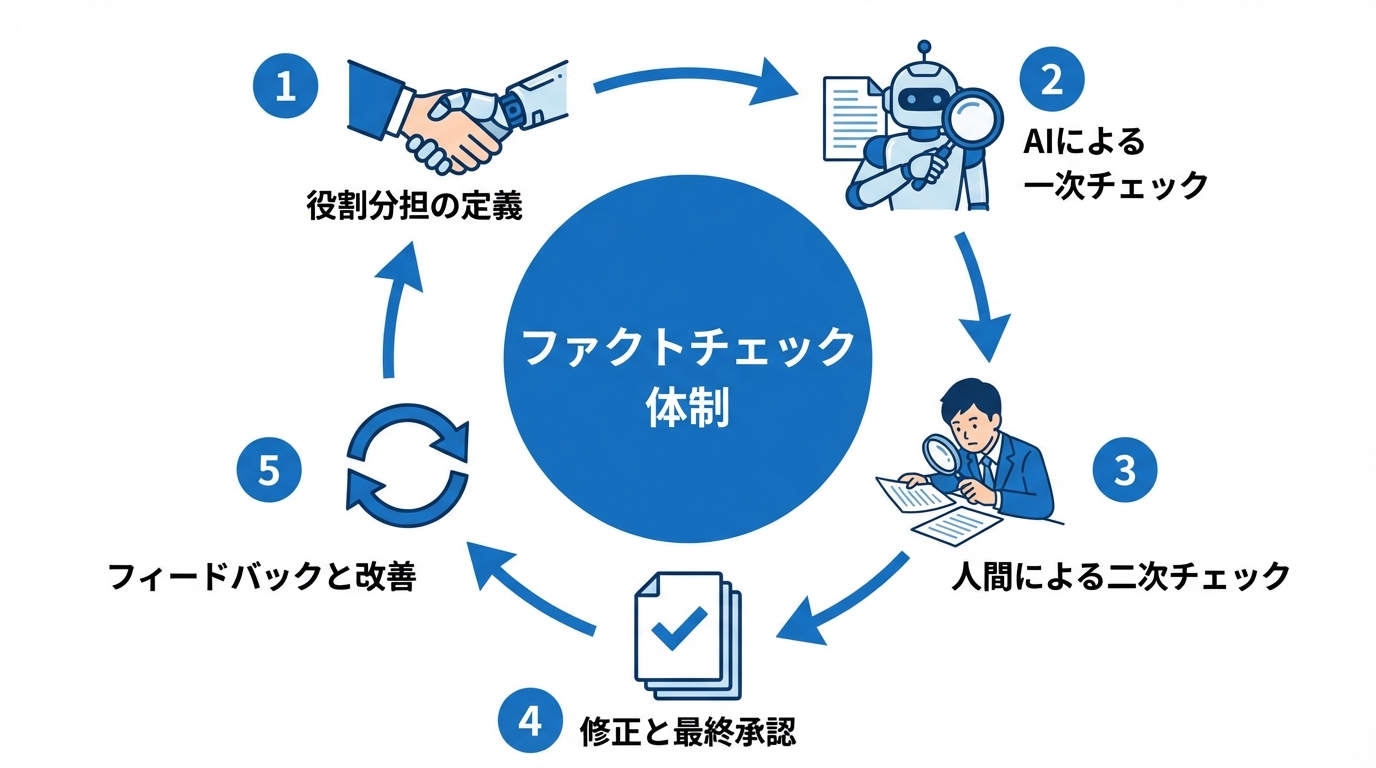

AI×人間ダブルチェック体制の構築フロー【5ステップ】

AIと人間がそれぞれの得意領域を活かし、信頼性と効率性を両立させるファクトチェック体制は、どのように構築すればよいのでしょうか。ここでは、明日から実践可能な具体的な5つのステップを解説します。

Step1:役割分担の定義(AIと人間の得意領域を明確化)

効果的な協業の第一歩は、AIと人間の役割を明確に切り分けることです。この定義が曖昧なままでは、作業の重複や確認漏れが発生し、体制が形骸化してしまいます。

- AIの役割:網羅的な一次スクリーニング

- 記事中の数値、日付、固有名詞などを抽出し、正誤を検証する。

- 主張の根拠となる情報源(URL)を提示させる。

- コピーコンテンツの可能性を検知する。

- 矛盾する可能性のある記述を指摘させる。

- 人間の役割:文脈判断と最終承認

- AIが提示した情報源の信頼性(一次情報か、権威ある機関か)を評価する。

- 記事全体の主張に論理的な一貫性があるかを確認する。

- メディアのブランドイメージや論調と合致しているかを判断する。

- 倫理的、社会的に配慮が必要な表現がないかを吟味する。

- 公開の可否について最終的な意思決定を行う。

この役割分担をチームの共通認識とすることで、属人性を排し、誰が担当しても安定した品質を担保できるチェックフローの基盤が整います。

Step2:AIによる一次チェックの実行とプロンプト設計

AIに一次チェックを効果的に実行させるには、指示、すなわちプロンプトの設計が鍵を握ります。単に「この記事の間違いを指摘して」と依頼するだけでは、AIの能力を最大限に引き出すことはできません。

重要なのは、後の人間によるチェック工程がスムーズに進むよう、「出力形式」を具体的に指定することです。例えば、「指摘事項をリストアップするだけでなく、その根拠となったURLと併せて表形式で出力してください」といった指示が有効です。戦略的なプロンプトは、単にAIから答えを得るためだけでなく、後続のワークフロー全体を最適化するために設計するべきです。

Step3:人間による二次チェック(AIの出力をどう判断するか)

AIからのチェック結果を受け取った人間は、それを鵜呑みにするのではなく、主体的な判断基準をもって検証する必要があります。

- 情報源の精査

AIが提示した出典URLは本当に信頼できるか?(一次情報、公的機関、権威ある研究機関、信頼できる報道機関か、それとも単なる個人ブログやまとめサイトか) - 文脈の確認

AIが「矛盾している」と指摘した箇所は、本当に論理が破綻しているか?(文脈によっては意図的な対比や逆説的な表現である可能性はないか) - 事実の再検証

特に重要な統計データや法律に関する記述は、AIの提示した情報源だけでなく、別の信頼できる情報源でも裏付けを取る(クロスチェック)。

AIはあくまで「思考のきっかけ」を提供してくれる存在です。その指摘をトリガーとし、人間がより深い思考と検証を行うことで、情報の精度は飛躍的に高まります。

Step4:修正内容の反映と最終承認

二次チェックで明らかになった修正点を、ミスなく確実に記事へ反映させるための承認フローを確立します。

- 修正担当者

二次チェックの結果に基づき、記事の原文を修正する。 - 確認者

修正が指示通り正確に行われているか、修正によって新たな不整合が生まれていないかを再確認する(ダブルチェック)。 - 最終承認者

修正が完了した最終稿を確認し、公開の最終判断を下す。

このプロセスを円滑に進めるため、Googleドキュメントの提案モードやコメント機能、変更履歴などを活用すると、誰がどこをどのように修正したかが明確になり、ヒューマンエラーを防ぐことができます。

Step5:フィードバックループの構築とナレッジ化

ファクトチェックのプロセスは、一度きりの作業で終わらせてはいけません。そこで得られた知見を組織の資産として蓄積し、継続的に品質を向上させる「フィードバックループ」を構築しましょう。

- ナレッジベースの構築

チェック工程で見つかった誤りのパターン(例:「この統計データは古い情報源を参照しがち」)、判断に迷った事例、効果的だったプロンプトなどを記録し、チーム内で共有する。 - ガイドラインの更新

蓄積されたナレッジを基に、AI記事の執筆・編集ガイドラインを定期的に見直し、改善する。

このループを回し続けることで、AIへの指示が洗練され、人間のチェック効率も向上します。結果として、組織全体のコンテンツ品質管理能力が底上げされ、AIを使いこなす専門家チームへと成長していくことができるのです。

AIのチェック結果を効率化する「出力形式」最適化の技術

AIによるファクトチェックの効率は、指示の出し方、特に「出力形式の指定」によって劇的に変わります。ここでは、人間が最もレビューしやすい、実践的な3つの出力形式を具体的なプロンプト例と共に紹介します。

非効率な指示:「修正点を文章で教えて」の限界

多くの人がやりがちなのが、「この記事の間違いを教えて」といった曖昧な指示です。これでは、AIから長文のテキストで回答が返ってくることが多く、人間は以下の非効率な作業を強いられます。

- 長文の中から、本当に重要な指摘事項を探し出す手間。

- 指摘が原文のどの部分に対応するのかを特定する手間。

- 修正作業の優先順位付けや、担当者への割り振りのしにくさ。

このような「あるある」な失敗を避けるため、AIには明確なフォーマットで回答するよう指示することが不可欠です。

最適解1:表形式(マークダウン)で指摘箇所と根拠を一覧化

最も基本的かつ効果的なのが、マークダウンの表形式で出力させる方法です。これにより、指摘事項を構造化し、一目で全体像を把握できます。

プロンプト例:

以下の記事についてファクトチェックを行い、問題点を下記の形式のマークダウンテーブルで出力してください。

| 指摘箇所(原文抜粋) | 問題点 | 修正提案 | 根拠URL |

この形式で出力されれば、人間は問題点と修正提案を比較し、根拠URLをワンクリックで確認できます。修正作業の進捗管理や、複数人での分業も格段に容易になります。

最適解2:差分表示形式(diff)で修正案を直接提示させる

より高度な手法として、プログラムコードのバージョン管理で使われる「diff形式」を応用する方法があります。修正箇所が視覚的にハイライトされ、レビューの速度を飛躍的に向上させます。

プロンプト例:

以下の記事についてファクトチェックを行い、修正が必要な箇所をdiff形式で示してください。削除箇所は

-で、追加箇所は+で表現してください。

出力イメージ:

– 日本の現在の総理大臣は、菅義偉です。 + 日本の現在の総理大臣は、高市早苗です。(2026年2月3日時点)

この形式であれば、人間は修正内容の妥当性を判断し、承認するだけで済みます。特に、細かな表現の修正や情報のアップデートにおいて絶大な効果を発揮します。

最適解3:コメント形式でWordPressに直接反映させる

最終的なワークフローのゴールとして、AIの出力をCMS(コンテンツ管理システム)に直接反映させる形式も考えられます。これにより、コピー&ペーストの手間さえも削減できます。

プロンプト例:

以下の記事についてファクトチェックを行い、修正提案をHTMLのコメントタグの形式で、該当箇所の直前に追加してください。WordPressのHTMLエディタにそのままペーストできるようにしてください。

例:

この出力をWordPressのHTMLエディタに貼り付ければ、編集画面上でレビュー担当者への指示が完了します。これは、実務に最も即した究極の効率化手法と言えるでしょう。こうしたCMSとのシームレスな連携は、WordPress AIプラグインの得意とする領域です。

組織に浸透させるためのルール作りと注意点

構築したファクトチェック体制を形骸化させず、組織文化として定着させるためには、明確なルール作りと責任体制の構築が不可欠です。

ファクトチェックリストの作成と運用

担当者のスキルや経験に依存せず、誰がチェックしても一定の品質を担保できるよう、標準化された「ファクトチェックリスト」を作成し、運用しましょう。

チェックリストに含めるべき項目の例:

- 【情報源】主張の根拠は一次情報(公的機関、元論文など)に基づいているか?

- 【鮮度】統計データや法律に関する情報は、最新のものが反映されているか?

- 【専門性】YMYL領域の場合、専門家による監修は行われているか?

- 【権利】使用している画像や引用は、著作権を侵害していないか?(法規制への準拠)

- 【倫理観】差別的、扇動的、あるいは他者を不快にさせる可能性のある表現はないか?

このリストに沿ってチェックを行うことで、確認漏れという最も基本的なヒューマンエラーを防ぎます。

責任の所在の明確化:最終承認者は誰か

AIが生成したコンテンツであっても、その内容に対する最終的な責任は、AIや個々のライターではなく、メディアを運営する組織が負います。そのため、公開されるすべてのコンテンツに対して責任を負う「編集長」や「コンテンツ責任者」を明確に任命することが極めて重要です。

最終承認者の役割と権限を組織図や業務分掌で定義することで、万が一問題が発生した際にも、迅速かつ適切な対応が可能となります。これは、組織としてのガバナンスを強化し、安心してAI導入を進めるための必須の防衛策です。企業のAIコンテンツ戦略において、この責任体制の構築は根幹をなす要素と言えるでしょう。

より詳細なガイドライン策定の参考として、独立行政法人情報処理推進機構(IPA)が公開している資料も役立ちます。

まとめ:AIを信頼できるパートナーに変えるために

本記事では、AIが生成した記事の信頼性を担保するための、人間とAIの協業によるファクトチェック体制の構築方法を解説しました。

重要なのは、AIを万能の魔法の道具と見なすのではなく、人間の監督下で真価を発揮する「優秀なアシスタント」と正しく位置づけることです。AIに網羅的な一次チェックを任せ、人間はより高度な文脈判断や最終的な意思決定に集中する。この役割分担こそが、品質と効率を両立させる鍵となります。

特に、AIのチェック結果を最適化する「出力形式」の工夫は、日々の業務効率を劇的に改善します。表形式やdiff形式といったテクニックを導入することで、AIは単なるチェックツールから、人間の思考を加速させる「信頼できるパートナー」へと昇華するでしょう。

AI時代において、コンテンツの質と量の両立は避けて通れない課題です。本記事で紹介した体制と技術が、皆様のメディア運営における不安を解消し、AIと共に高品質なコンテンツを創造していくための一助となれば幸いです。